Data Analytics Fundamentals: Data Analytics Fundamentals refers to the foundational concepts and techniques used in analyzing and interpreting data for decision-making. This skill is measured in the test to ensure that candidates possess a solid understanding of data analytics principles, such as data cleaning, data visualization, data manipulation, and statistical analysis, which are essential for effectively extracting insights from large datasets.

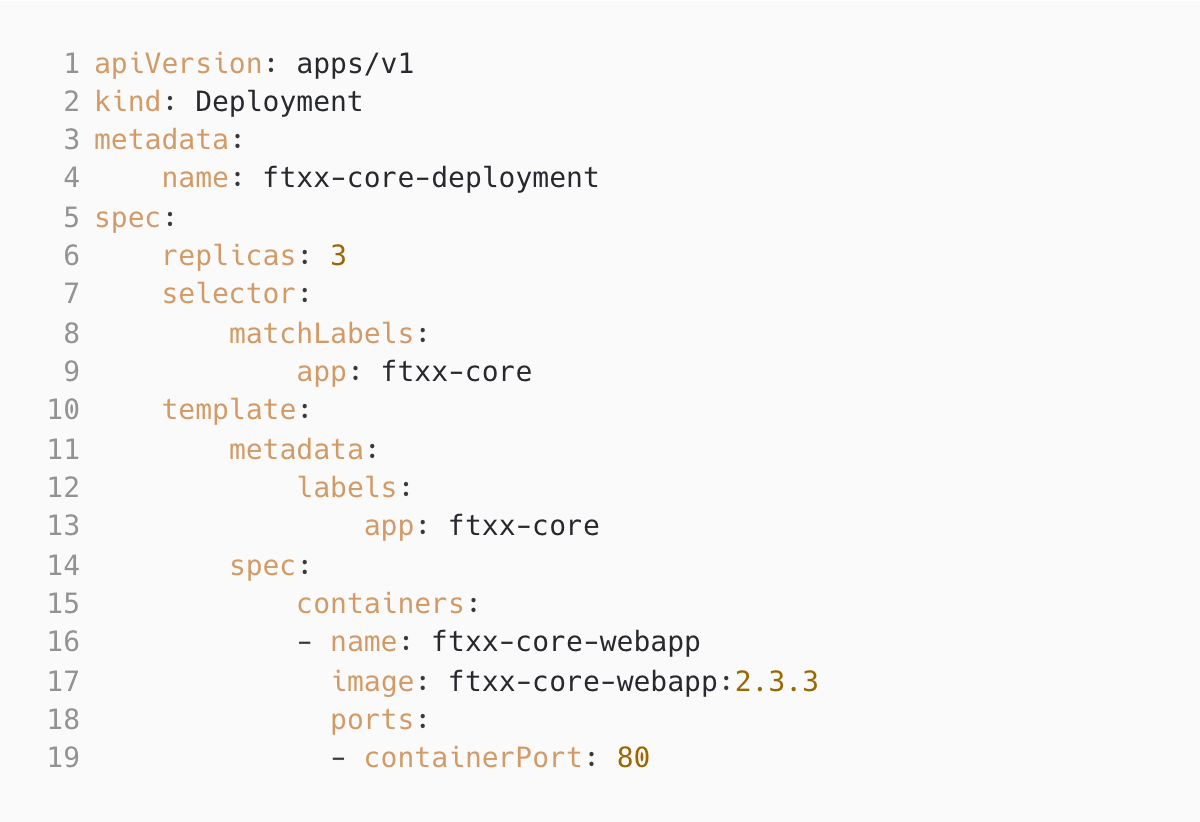

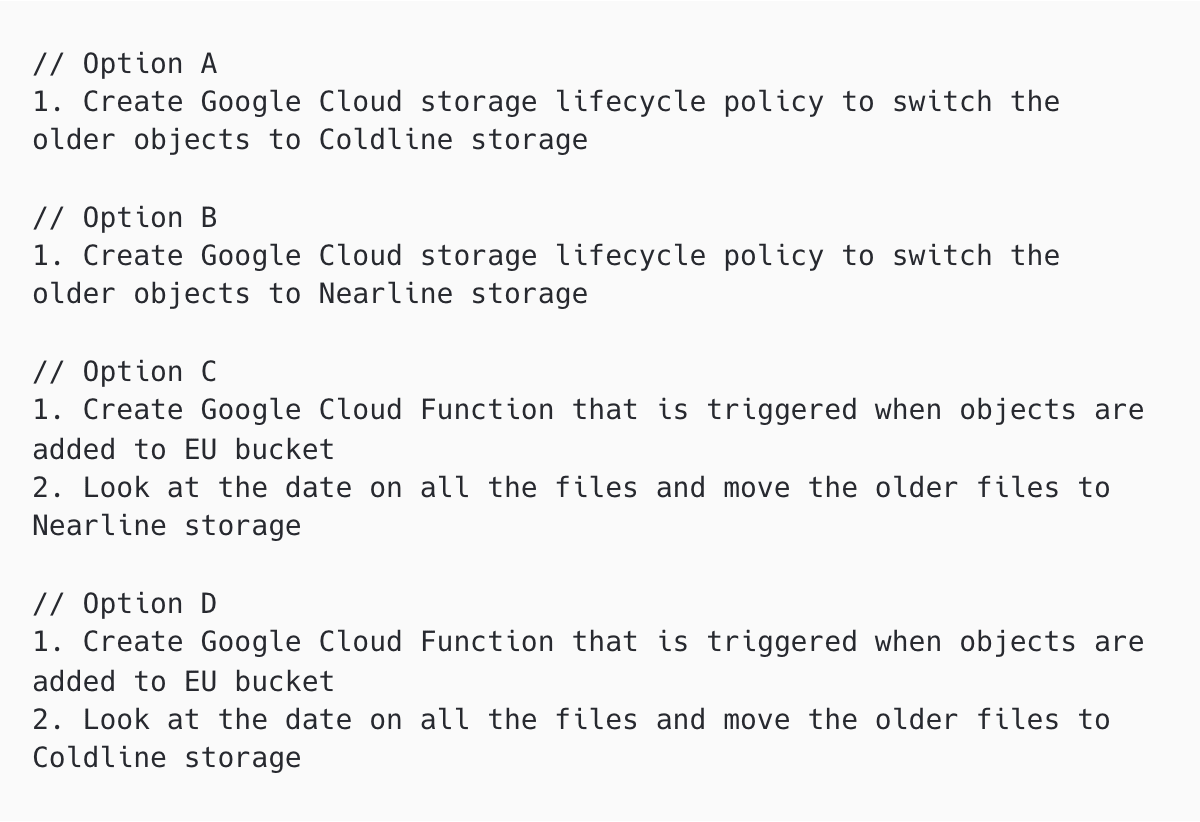

Google Cloud Platform Basics: Google Cloud Platform (GCP) Basics covers the fundamental knowledge of the various tools and services offered by Google Cloud. Candidates are expected to have an understanding of the core GCP services like Compute Engine, Storage, and Networking, as well as be familiar with concepts such as virtual machines, cloud storage, load balancing, and autoscaling. This skill is measured in the test to assess a candidate's proficiency in utilizing GCP for data analytics tasks, which is increasingly important in modern data-driven organizations.