Test Duration

~ 35 minsDifficulty Level

Moderate

Questions

- 7 PowerCenter MCQs

- 3 SQL MCQs

- 3 ETL MCQs

- 3 Data Warehouse MCQs

Availability

Available as custom testThe Informatica test evaluates a candidate's ability to use PowerCenter for ETL. It assesses ability to execute data synchronization/ replication tasks, design data transformations, manage source/ target definitions and data wrangling by applying filter, join, aggregate, categorize, merge, and expression logic without writing SQL.

Covered skills:

Test Duration

~ 35 minsDifficulty Level

Moderate

Questions

Availability

Available as custom testThe Informatica Online Test helps recruiters and hiring managers evaluate candidates' skills in data warehousing and ETL processes. This test aids in making informed hiring decisions by providing an objective assessment of candidates' abilities, streamlining the selection process and reducing the time spent on interviewing unqualified applicants.

This test evaluates candidates on their understanding of data warehousing concepts, ETL methodologies, and data integration techniques. It assesses their ability to work with relational databases, perform CRUD operations, and design database joins. The test also covers advanced topics such as mapplets, parameterization, workflows, sessions, tasks, and transformations, providing a complete picture of the candidate's expertise in Informatica and related technologies.

Use Adaface tests trusted by recruitment teams globally. Adaface skill assessments measure on-the-job skills of candidates, providing employers with an accurate tool for screening potential hires.

We have a very high focus on the quality of questions that test for on-the-job skills. Every question is non-googleable and we have a very high bar for the level of subject matter experts we onboard to create these questions. We have crawlers to check if any of the questions are leaked online. If/ when a question gets leaked, we get an alert. We change the question for you & let you know.

How we design questionsThese are just a small sample from our library of 15,000+ questions. The actual questions on this Informatica Online Test will be non-googleable.

| 🧐 Question | |||||

|---|---|---|---|---|---|

|

Medium

Multi Select

|

Solve

|

||||

|

|

|||||

|

Medium

nth highest sales

|

Solve

|

||||

|

|

|||||

|

Medium

Select & IN

|

Solve

|

||||

|

|

|||||

|

Medium

Sorting Ubers

|

Solve

|

||||

|

|

|||||

|

Hard

With, AVG & SUM

|

Solve

|

||||

|

|

|||||

|

Medium

Data Merging

|

Solve

|

||||

|

|

|||||

|

Medium

Data Updates

|

Solve

|

||||

|

|

|||||

|

Medium

SQL in ETL Process

|

Solve

|

||||

|

|

|||||

|

Medium

Trade Index

|

Solve

|

||||

|

|

|||||

|

Medium

Marketing Database

|

Solve

|

||||

|

|

|||||

|

Medium

Multidimensional Data Modeling

|

Solve

|

||||

|

|

|||||

|

Medium

Optimizing Query Performance

|

Solve

|

||||

|

|

|||||

| 🧐 Question | 🔧 Skill | ||

|---|---|---|---|

|

Medium

Multi Select

|

2 mins SQL

|

Solve

|

|

|

Medium

nth highest sales

|

3 mins SQL

|

Solve

|

|

|

Medium

Select & IN

|

3 mins SQL

|

Solve

|

|

|

Medium

Sorting Ubers

|

3 mins SQL

|

Solve

|

|

|

Hard

With, AVG & SUM

|

2 mins SQL

|

Solve

|

|

|

Medium

Data Merging

|

2 mins ETL

|

Solve

|

|

|

Medium

Data Updates

|

2 mins ETL

|

Solve

|

|

|

Medium

SQL in ETL Process

|

3 mins ETL

|

Solve

|

|

|

Medium

Trade Index

|

3 mins ETL

|

Solve

|

|

|

Medium

Marketing Database

|

2 mins Data Warehouse

|

Solve

|

|

|

Medium

Multidimensional Data Modeling

|

2 mins Data Warehouse

|

Solve

|

|

|

Medium

Optimizing Query Performance

|

2 mins Data Warehouse

|

Solve

|

| 🧐 Question | 🔧 Skill | 💪 Difficulty | ⌛ Time | ||

|---|---|---|---|---|---|

|

Multi Select

|

SQL

|

Medium | 2 mins |

Solve

|

|

|

nth highest sales

|

SQL

|

Medium | 3 mins |

Solve

|

|

|

Select & IN

|

SQL

|

Medium | 3 mins |

Solve

|

|

|

Sorting Ubers

|

SQL

|

Medium | 3 mins |

Solve

|

|

|

With, AVG & SUM

|

SQL

|

Hard | 2 mins |

Solve

|

|

|

Data Merging

|

ETL

|

Medium | 2 mins |

Solve

|

|

|

Data Updates

|

ETL

|

Medium | 2 mins |

Solve

|

|

|

SQL in ETL Process

|

ETL

|

Medium | 3 mins |

Solve

|

|

|

Trade Index

|

ETL

|

Medium | 3 mins |

Solve

|

|

|

Marketing Database

|

Data Warehouse

|

Medium | 2 mins |

Solve

|

|

|

Multidimensional Data Modeling

|

Data Warehouse

|

Medium | 2 mins |

Solve

|

|

|

Optimizing Query Performance

|

Data Warehouse

|

Medium | 2 mins |

Solve

|

With Adaface, we were able to optimise our initial screening process by upwards of 75%, freeing up precious time for both hiring managers and our talent acquisition team alike!

Brandon Lee, Head of People, Love, Bonito

It's very easy to share assessments with candidates and for candidates to use. We get good feedback from candidates about completing the tests. Adaface are very responsive and friendly to deal with.

Kirsty Wood, Human Resources, WillyWeather

We were able to close 106 positions in a record time of 45 days! Adaface enables us to conduct aptitude and psychometric assessments seamlessly. My hiring managers have never been happier with the quality of candidates shortlisted.

Amit Kataria, CHRO, Hanu

We evaluated several of their competitors and found Adaface to be the most compelling. Great library of questions that are designed to test for fit rather than memorization of algorithms.

Swayam Narain, CTO, Affable

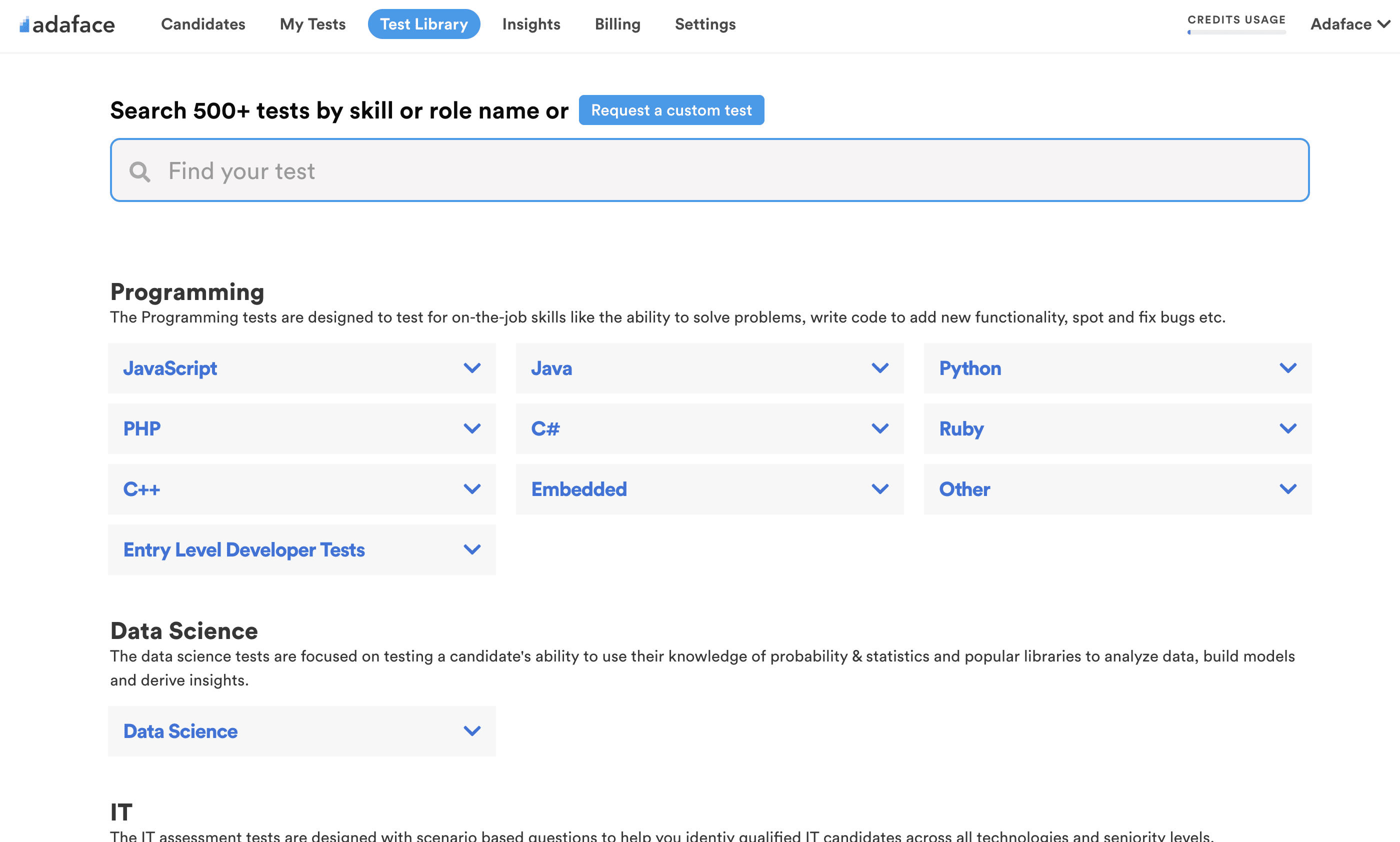

The Adaface test library features 500+ tests to enable you to test candidates on all popular skills- everything from programming languages, software frameworks, devops, logical reasoning, abstract reasoning, critical thinking, fluid intelligence, content marketing, talent acquisition, customer service, accounting, product management, sales and more.

The Informatica Online Test is designed to assess a candidate's proficiency in Informatica tools and data warehousing concepts. It is used by recruiters to evaluate skills such as ETL, data integration, and SQL operations.

Yes, recruiters can request a custom test combining Informatica with ETL-related questions. Check out our ETL Assessment Test for more details on how we assess ETL skills.

Senior roles are assessed on advanced topics like data quality management, error handling in ETL processes, performance optimization, real-time data integration, and metadata management.

Use the test as a pre-screening tool at the start of your recruitment. Add a link to the assessment in the job post or invite candidates directly by email.

The main Data Warehousing tests in our library include:

Yes, absolutely. Custom assessments are set up based on your job description, and will include questions on all must-have skills you specify. Here's a quick guide on how you can request a custom test.

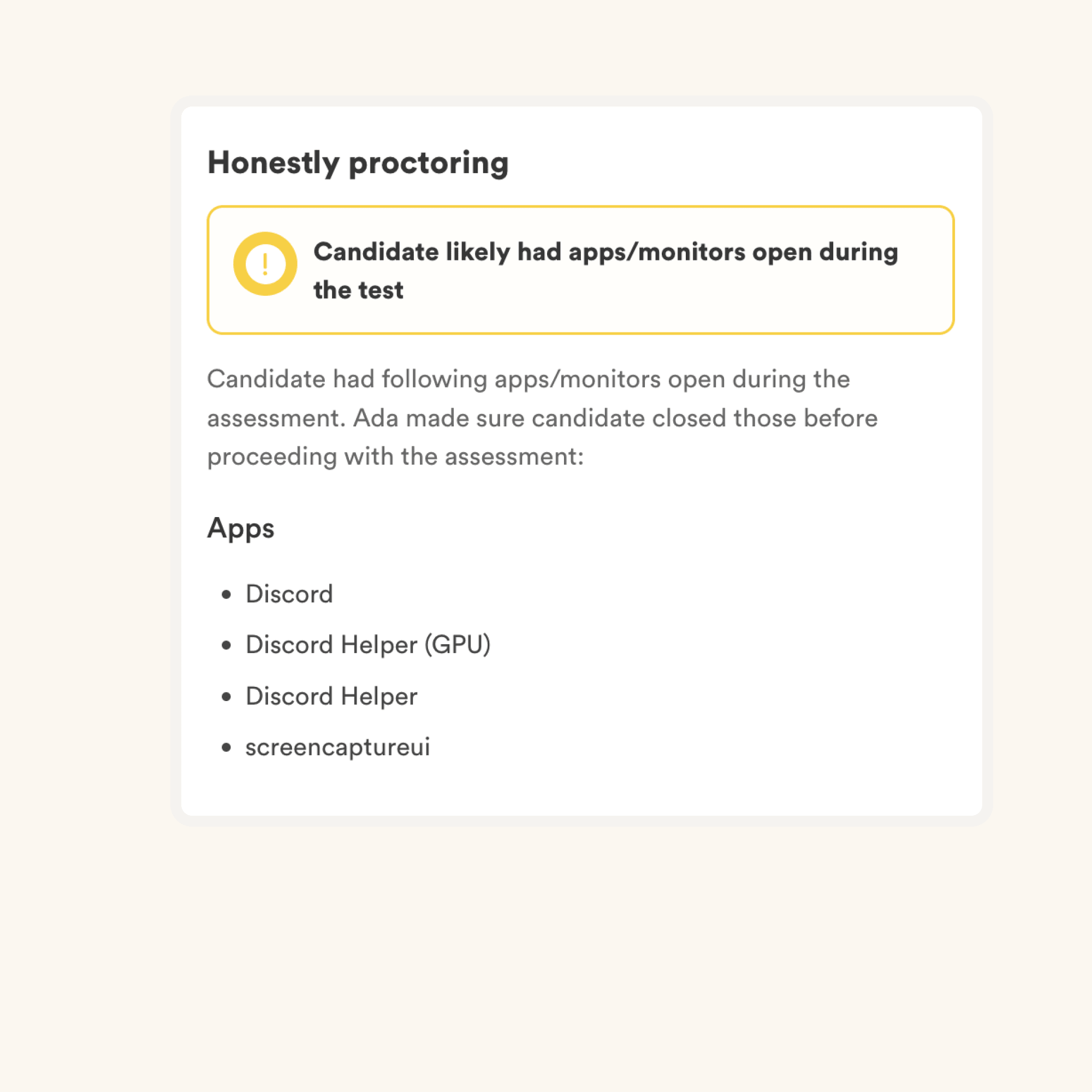

We have the following anti-cheating features in place:

Read more about the proctoring features.

The primary thing to keep in mind is that an assessment is an elimination tool, not a selection tool. A skills assessment is optimized to help you eliminate candidates who are not technically qualified for the role, it is not optimized to help you find the best candidate for the role. So the ideal way to use an assessment is to decide a threshold score (typically 55%, we help you benchmark) and invite all candidates who score above the threshold for the next rounds of interview.

Each Adaface assessment is customized to your job description/ ideal candidate persona (our subject matter experts will pick the right questions for your assessment from our library of 10000+ questions). This assessment can be customized for any experience level.

Yes, it makes it much easier for you to compare candidates. Options for MCQ questions and the order of questions are randomized. We have anti-cheating/ proctoring features in place. In our enterprise plan, we also have the option to create multiple versions of the same assessment with questions of similar difficulty levels.

No. Unfortunately, we do not support practice tests at the moment. However, you can use our sample questions for practice.

You can check out our pricing plans.

Yes, you can sign up for free and preview this test.

Here is a quick guide on how to request a custom assessment on Adaface.